En una era donde la vida pasa por el streaming, las empresas necesitan soluciones dinámicas y moldeadas para la toma de decisiones en tiempo real, y el procesamiento descentralizado para la infraestructura de TI se ha tornado esencial para alcanzar dicho objetivo.

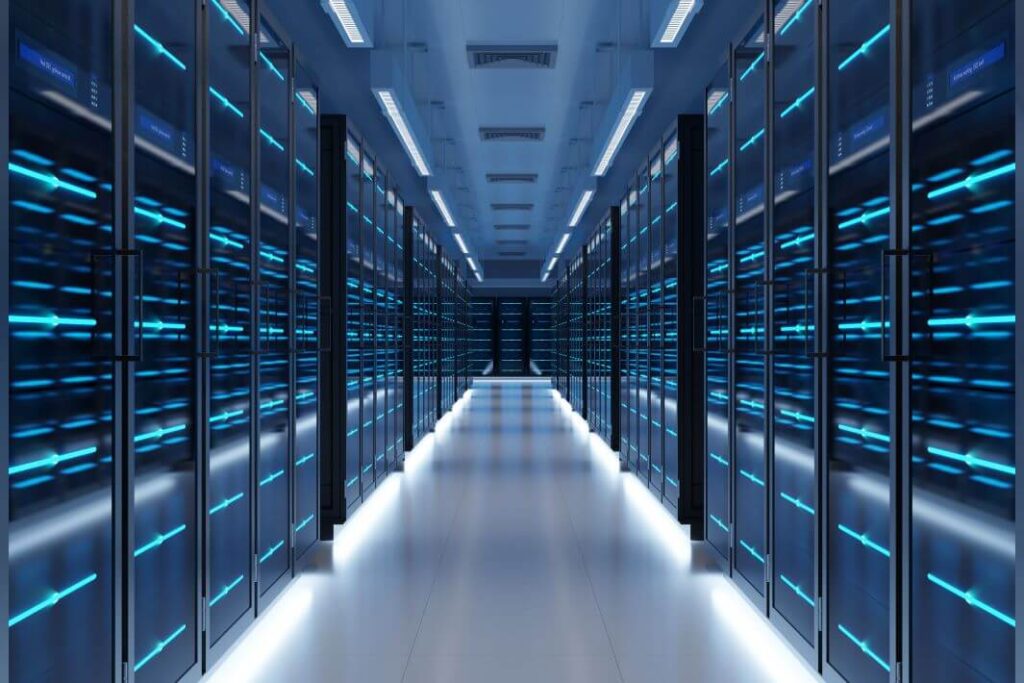

Para entender este tema, primero hace falta definir qué es una red descentralizada. Esta red se implementa cuando no hay necesidad de contar con servidores instalados en la empresa. Los servidores están localizados en la famosa nube.

La nube está integrada por varios proveedores de servicios que cuidan del mantenimiento y de la integridad de los datos de la empresa contratante. Además, no se trata de un paquete cerrado de una única solución para ser utilizado de determinada manera.

Es posible utilizar un sistema multinube para moldear las cargas de trabajo y componer módulos con todas las soluciones disponibles. Por ejemplo, puede contratar diferentes servidores en la nube y componer las soluciones que se adapten a sus necesidades.

Así, un sistema de redes descentralizadas -que forma la multinube- es muy eficiente para optimizar procesos, economizando tiempo, dinero y generando una dinámica más ágil para las soluciones específicas que cada empresa necesita.

Pero hay un punto al que debemos estar atentos: para gerenciar sistemas de múltiples nubes, hace falta pensar en el todo, crear una estrategia para distribuir las cargas de trabajo y también usar las tecnologías adecuadas. Y es en este punto donde entra en juego la gestión de nubes múltiples.

Gestión multinube y computación de borde

Hoy existe una capacidad inmensa de soluciones de tecnología. Y con múltiples nubes en uso, es necesario dimensionar los parámetros correctos para cada cliente.

En el caso de Lumen, una de las soluciones es su producto Cloud Application Manager. Con esta aplicación, realizamos el gerenciamiento multinube. Conectamos todas las nubes y los servicios de los clientes, no solo en los proveedores de nube pública, sino también en los servidores de nube privada.

Eso implica una actuación en edge computing, o computación de borde, donde los datos son procesados en la nube antes de ser enviados. Son servidores que están situados en el borde de la nube, cerca del cliente.

Con esta tecnología, no es necesario que los datos fluyan a un servidor y luego se entreguen al cliente. Por lo tanto, la computación de borde es esencial para disminuir la latencia del tráfico y así permitir que el cliente tome decisiones casi en tiempo real.

Más eficiencia e inteligencia para los sistemas

Podemos citar el caso de una empresa que exhibe medios (publicidad). Para exhibir los anuncios, es necesario que comprenda el perfil de su audiencia. Si el panel de medios está en un ascensor, por ejemplo, el sistema detecta si se trata de niños, adultos, mujeres u hombres. Por lo tanto, debe tomar esa decisión en cuestión de segundos para entregar los medios correctos y llegar al público cuya presencia es mayoritaria en el ascensor.

En este ejemplo, es necesaria la computación de borde para que el sistema tome la decisión sobre qué publicidad mostrar en el menor tiempo posible. Si tarda demasiado, se pierde la audiencia objetivo y el sistema no cumple su propósito.

Cloud Application Manager garantiza que la workload (carga de trabajo) que toma la decisión de exhibir la publicidad correcta esté donde tiene que estar y no en otro lugar de la red, en cuestión de segundos.

Otro ejemplo de computación de borde está dado por los dispositivos vestibles, tales como un reloj de monitoreo de salud. El dispositivo envía los datos críticos directamente al centro médico, sin necesidad de utilizar la nube y pasar antes por un servidor. Esto puede salvar vidas.

Con estos casos, podemos sintetizar algunas de las ventajas del procesamiento descentralizado:

- Mayor confiabilidad: con más proveedores en la nube, la posibilidad de que la empresa registre inactividad en el sistema es casi nula, porque en la multinube, el sistema continúa funcionando incluso si falla un servidor;

- Reducción de costos: equilibrio entre costos operativos y de capital. Como resultado, las empresas pueden innovar más rápidamente, entregando valor diferenciado a sus clientes y en sus productos;

- Mayor capacidad para escoger servicios: la mayoría de los proveedores de servicios en la nube cuenta con herramientas de gerenciamiento que ayudan a monitorear, optimizar y automatizar sus workloads;

- Para los equipos de TI: pueden ejecutar workloads individuales en el servicio en la nube. Esto aumenta la eficiencia de las aplicaciones y reduce los costos del área de TI.

Consideraciones a futuro

La tecnología de infraestructura será cada vez más distribuida: una parte en la nube, una parte local (también llamada on premise), una parte en el borde, pero principalmente orquestada.

Hoy en día, donde la toma de decisiones debe ser cada vez más rápida, no es posible depender de que varias personas operen manualmente esta infraestructura. Aquí es donde Lumen encaja muy bien: conectando la infraestructura de la nube, edge, on premise con las plataformas del cliente para que TI no sea el cuello de botella. Después de todo, TI no debería ser un obstáculo, todo lo contrario: debe ser el facilitador de la actividad principal de nuestros clientes.

Autor:

Fernando Zangrande

Sr. Manager, Edge Data Center, Cloud & Security

Lumen, Latin America

Licenciado en Tecnologías de la Información, con especialización y MBA en Gestión de Productos Tecnológicos. Lleva 20 años operando en el mercado tecnológico, trabajando para algunos de los principales proveedores de Data Center, Cloud Computing y Outsourcing de TI en América Latina. Actualmente en Lumen, es responsable de las estrategias de Cloud Computing y Edge Computing para América Latina, trabajando en productos y soluciones multinube con los principales socios de la región y a nivel mundial.